先做个广告:如需代注册帐号或代充值Chatgpt Plus会员,请添加站长客服微信:pingzi7749

今天(2024.5.14)凌晨,opai春季发布会,公布了GPT-4o,并且免费开放。

什么是GPT-4o

GPT-40("o"代表"omni")是迈向更自然的人机交互的一步:

它接受文本、音频和图像的任何组合作为输入,并生成文本、音频和图像的任何组合输出。

它可以在短至232毫秒的时间内对音频输入做出响应,平均为320毫秒,这与人类在对话中的响应时间相似。

它在英文文本和代码上与GPT-4Turbo性能相当,在非英文语言中的文本上有显著改进。

同时在API中速度更快,价格便宜50%。与现有型号相比,GPT-40在视觉和音频理方面尤其出色!

支持128k 上下文

与 GPT-4 Turbo 相比,GPT-4o 速度提高了 2 倍,价格减半,限制速率提高了 5 倍。

GPT-4o 输入:$5.00 / 1M tokens 输出:$15.00 / 1M tokens

GPT4-turbo 输入:$10.00 / 1M tokens 输出:$30.00 / 1M tokens

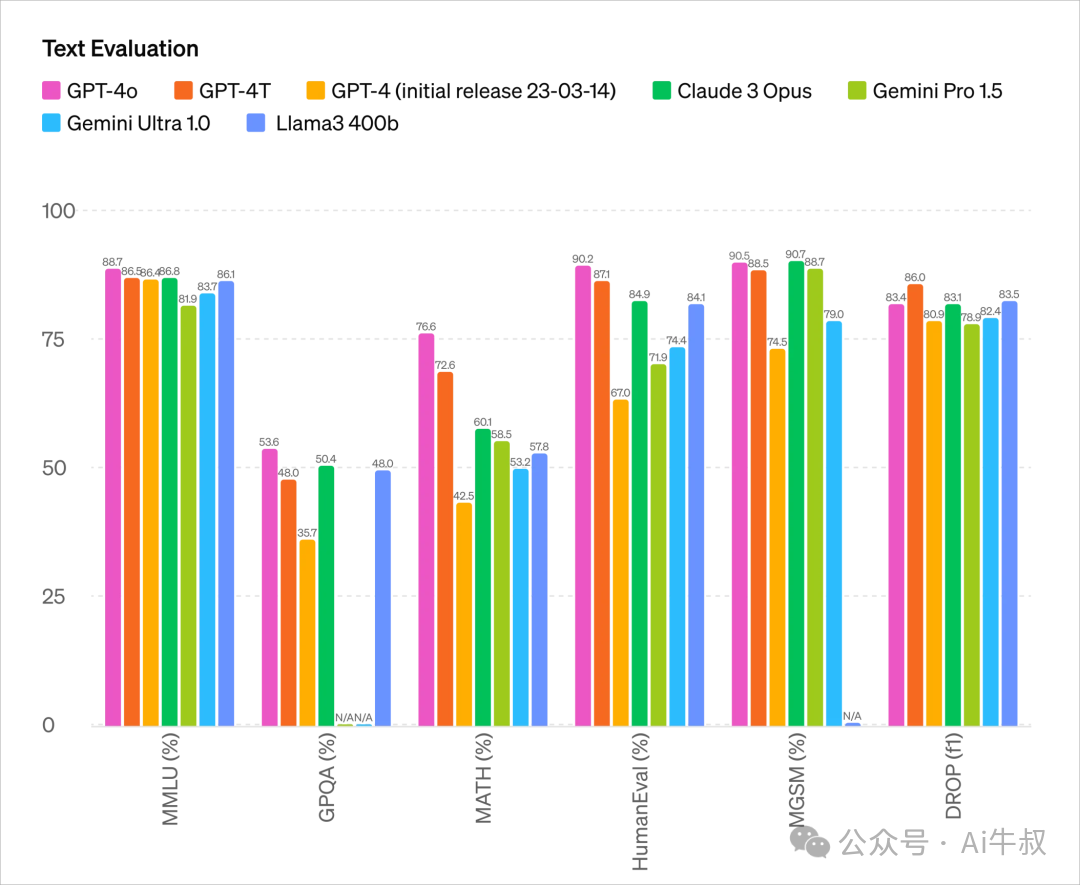

性能独领群雄

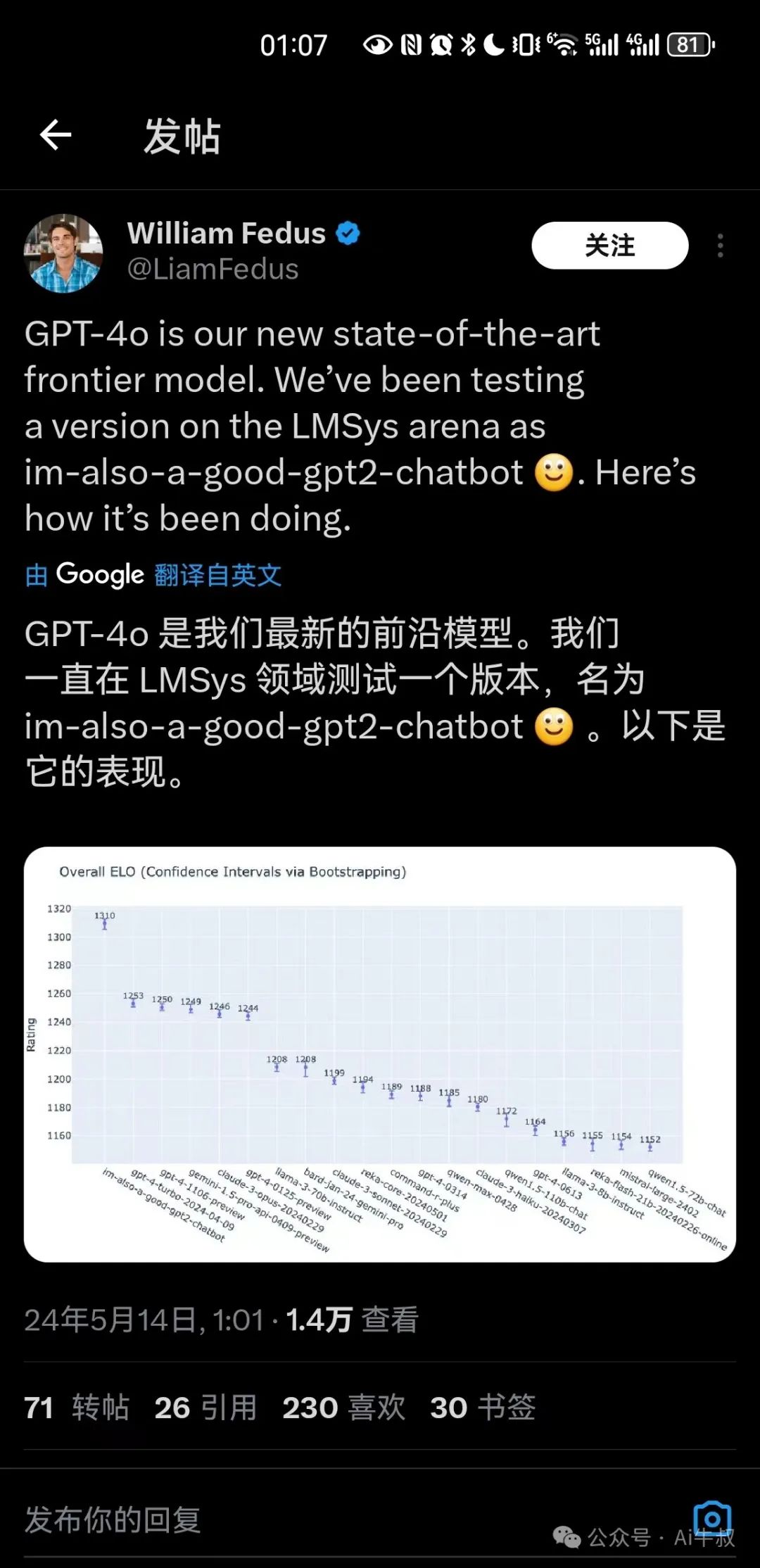

GPT-4o 就是前段时间,在 LMSys 竞技场上测试的im-also-a-good-gpt2-chatbot

文本测试数据:

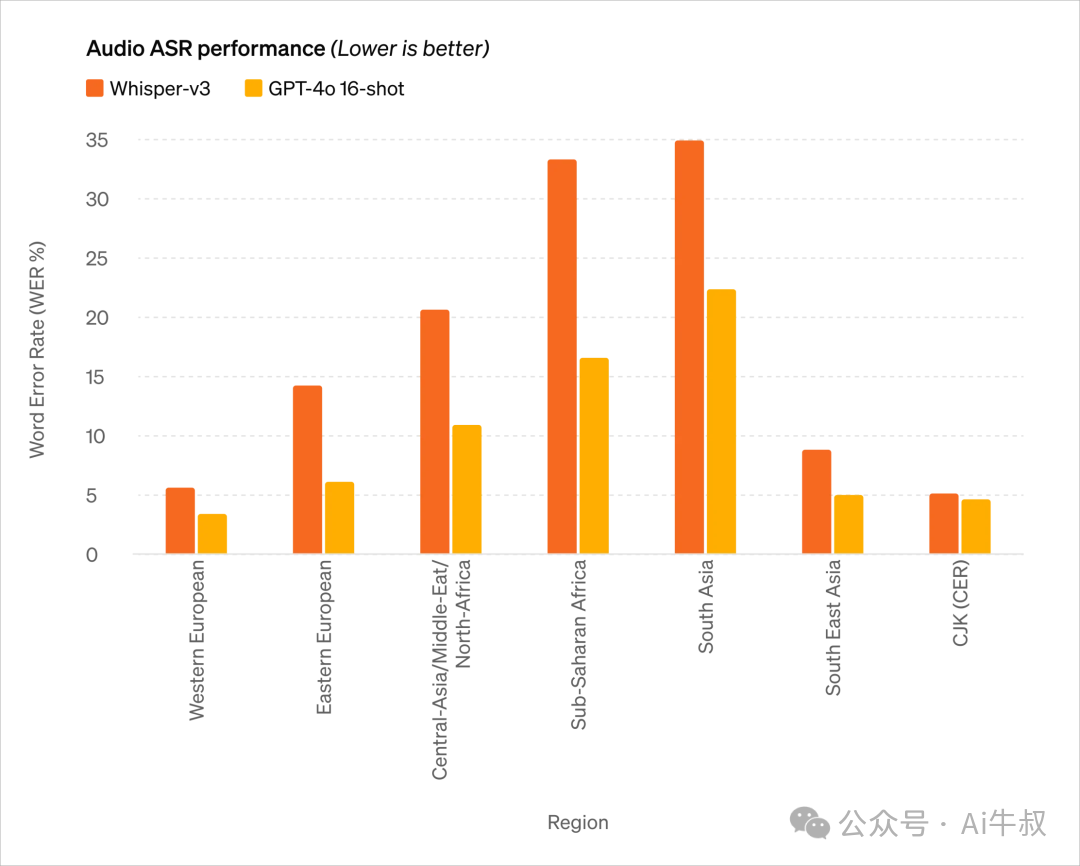

音频测试数据

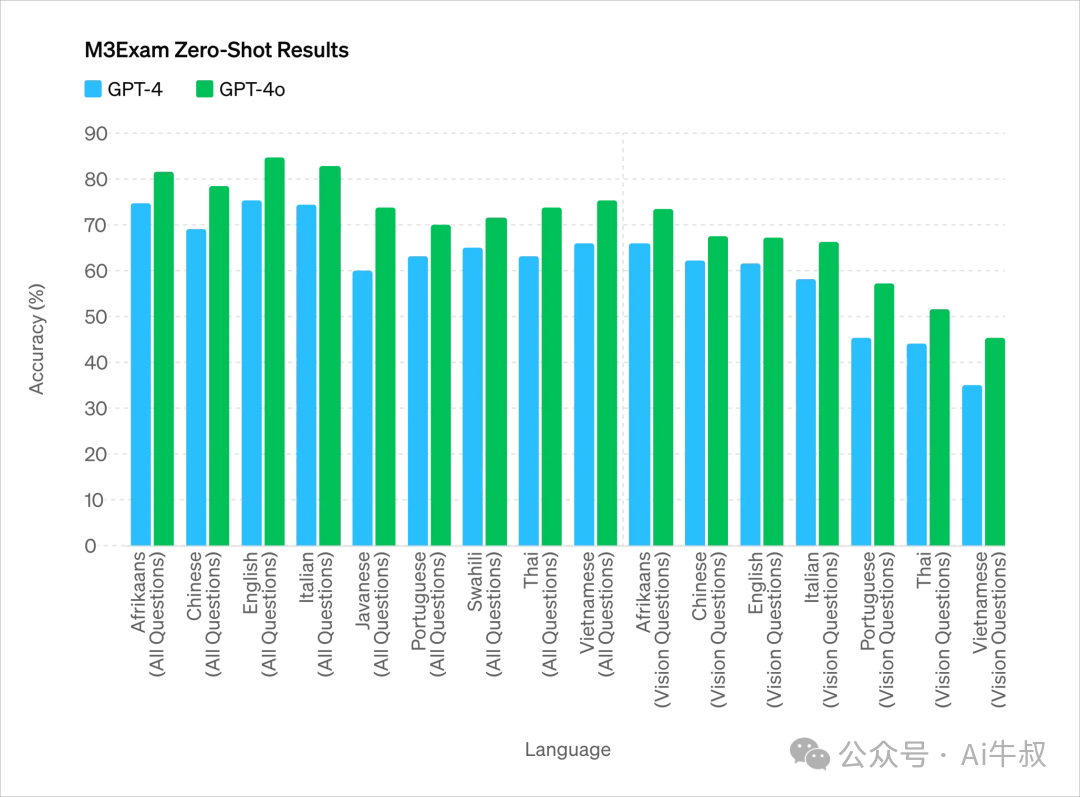

多语言测试数据:

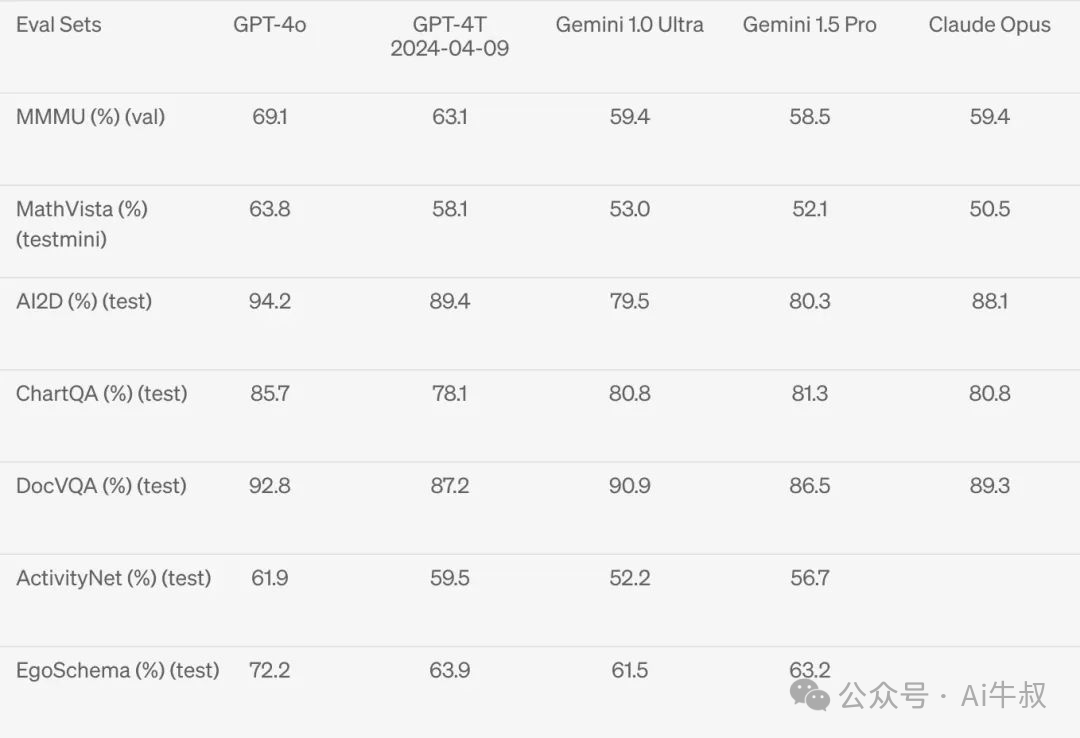

基于基准测试集的多模态测试数据完全碾压之前的其他大模型

功能强大无匹

1、语音实时对话

平均320毫秒响应的实时对话

对话过程可以随时打断、即时反应。

语音非常自然,语气情感逼真,跟真人一样

甚至能让她把答案唱出来

2、识别手写文字解答数学题

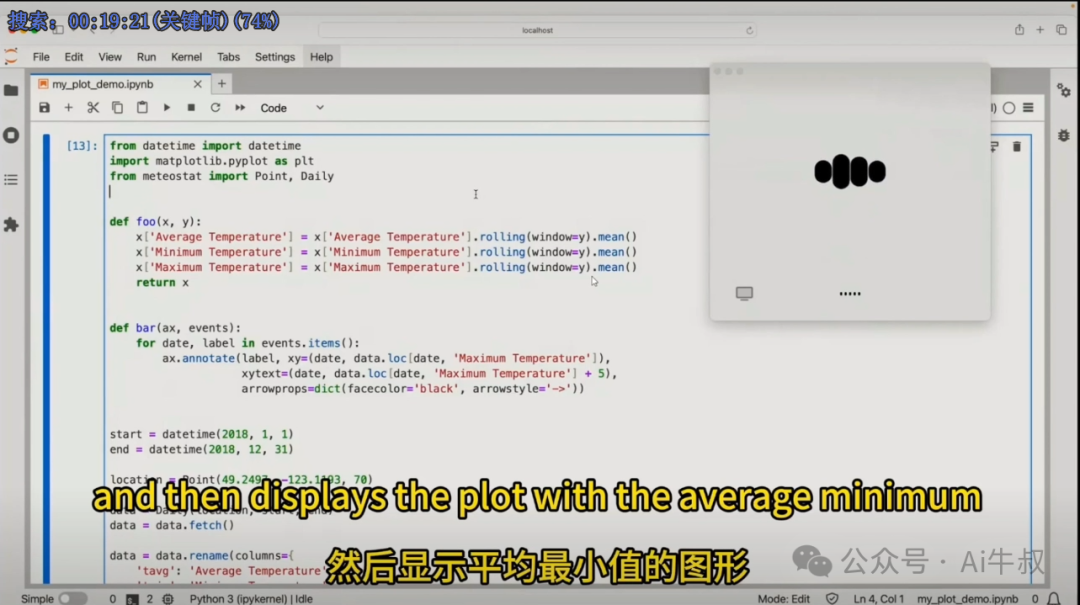

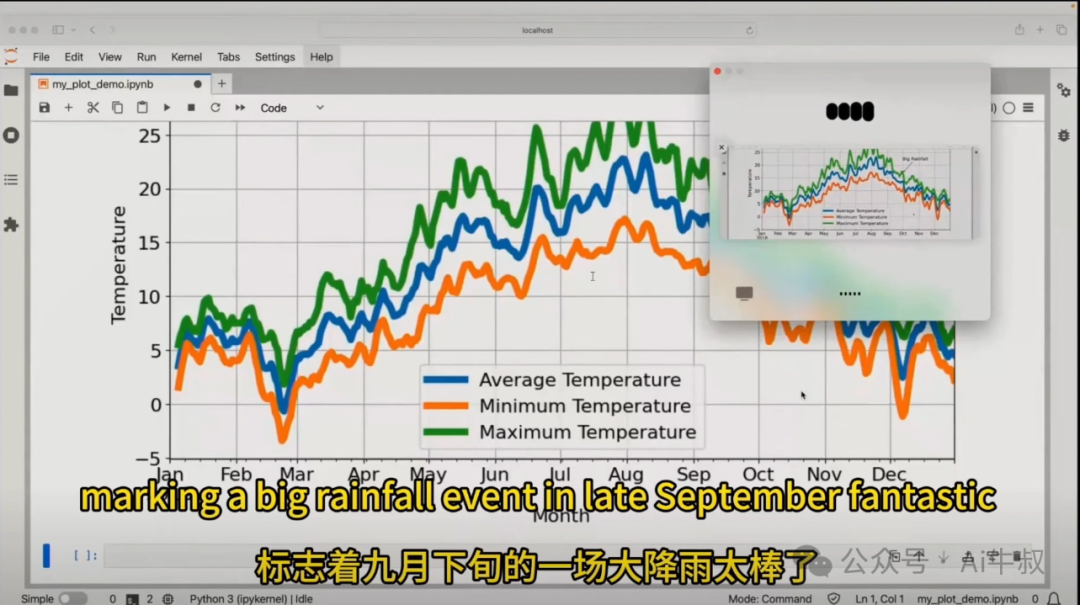

3、实时读取桌面代码,并进行代码解答。

4、实时理解图表,针对图表信息进行语音对话。

5、实时翻译各种语言

6、根据图像能准确的判断情绪

还能根据对象情绪发起讨论话题。

牛叔现在只能说一句牛逼。

国产大模型们,加油啊!

本文链接:https://www.vipbxr.vip/GPT5_358.html

GPT-4oGPT4ogpt-4o检测人的情绪gpt-4o多模态大模型发布GPT-4o免费GPT-4o官网GPT4o官网

网友评论